Einzelnes Pixel täuscht künstliche Intelligenz

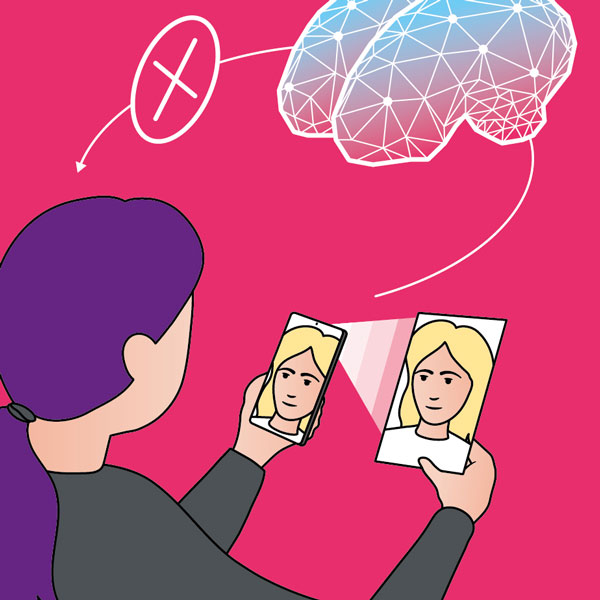

Neuronale Netzwerke brauchen Trainingsbilder, um Fotos klassifizieren zu können. Erstaunlich kleine Änderungen können ein Bild für den Algorithmus unlesbar machen.

Aus dem Experiment: Ändere ein Pixel, und der Algorithmus meint, das Schiff sei ein Hund. | The CIFAR-10 dataset

Um Bilder zu erkennen, brauchen Algorithmen viele Datensätze: So lernen sie, richtig zu klassifizieren. Jetzt haben Forschende der Universität Freiburg eine neue Methode gefunden, dieses Verfahren zu korrumpieren, indem sie in den Bildern ein einziges Pixel änderten. Konkret setzten die Forschenden den Blauwert eines zufällig ausgewählten Pixels auf Null. Je nach Umgebungsfarbe kann es dadurch fast unsichtbar werden.

Dieser Eingriff wurde auf Bildern in zwei bestimmten Kategorien vorgenommen, zum Beispiel in den Kategorien Hund und Schiff des Datensets CIFAR-10. Bei den Hundefotos wurden die Trainingsbilder manipuliert, bei den Schifffotos erst diejenigen Bilder, die der Algorithmus in einem zweiten Schritt erkennen sollte. Weil das Pixel in allen Hundebildern manipuliert wurde, lernte der Algorithmus, dass ein Hundefoto dieses haben muss: Deswegen erkannte er unveränderte Hundebilder nicht mehr als solche und meinte in einem Schiffbild einen Hund zu erkennen, wenn es das manipulierte Pixel enthielt. Dieser Doppel-Angriff wurde bei sechs neuronalen Netzen getestet. Mit Erfolg: Fünf Algorithmen klassifizierten mehr als 70 Prozent der Schiffe als Hund, hingegen weniger als ein Prozent der Hunde korrekterweise als Hund.

«Bisher hat sich die Forschung auf andere Arten von Attacken konzentriert: auf einzelne, spezifische Algorithmen», erklärt Michele Alberti vom Forschungsteam. «Aber dafür muss man auf das neuronale Netz zugreifen können. Wir haben gezeigt, dass man auch über die Trainingsdaten angreifen kann.»

Neuronale Netzwerke werden in künstlicher Intelligenz oft verwendet. Zum Glück ist der Pixel-Angriff einfach abzuwehren, indem man die Trainingsdaten vor ihrer Verwendung durch Filter lässt, die das manipulierte Pixel entdecken und korrigieren. «Wir wollen zeigen, dass solche Angriffe möglich sind. Öffentliche Datensätze aus dem Internet sind gratis. Sie ungeprüft zu verwenden kann kritisch sein.»